こんにちは。SB C&S の村上です。

この記事ではNVIDIA AI Enterpriseの概要からコンポーネント群について紹介します。

企業でのAI導入について

昨今、生成AIやAIエージェントの活用が進んでいます。ただし、企業でAIを導入するとなった場合は「動けばOK」では済まず、以下のような懸念点が発生します。

- 依存関係が多く、アップデートで壊れやすい

- セキュリティ/脆弱性対応、長期運用、サポートの体制が必要

- GPUドライバやKubernetes連携など、アプリ以前に"基盤づくり"が大変

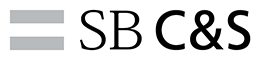

これは、AI周りで数多くのソフトウェアが登場することにも起因しています。

例えば、AIの開発環境1つ見てもプログラムランタイムから機械学習用フレームワーク、GPU用のライブラリなどと数多く登場し、それらのバージョンや互換性なども考える必要が出てきます。

他にもAIでは学習済みモデルを用意したり、GPUを使う場合はそれに必要なコンポーネントを準備したりと数多くのソフトウェアが出てきます。企業の目線ではこれらを統合して提供・サポートがされることが望ましいです。

NVIDIA AI Enterpriseとは

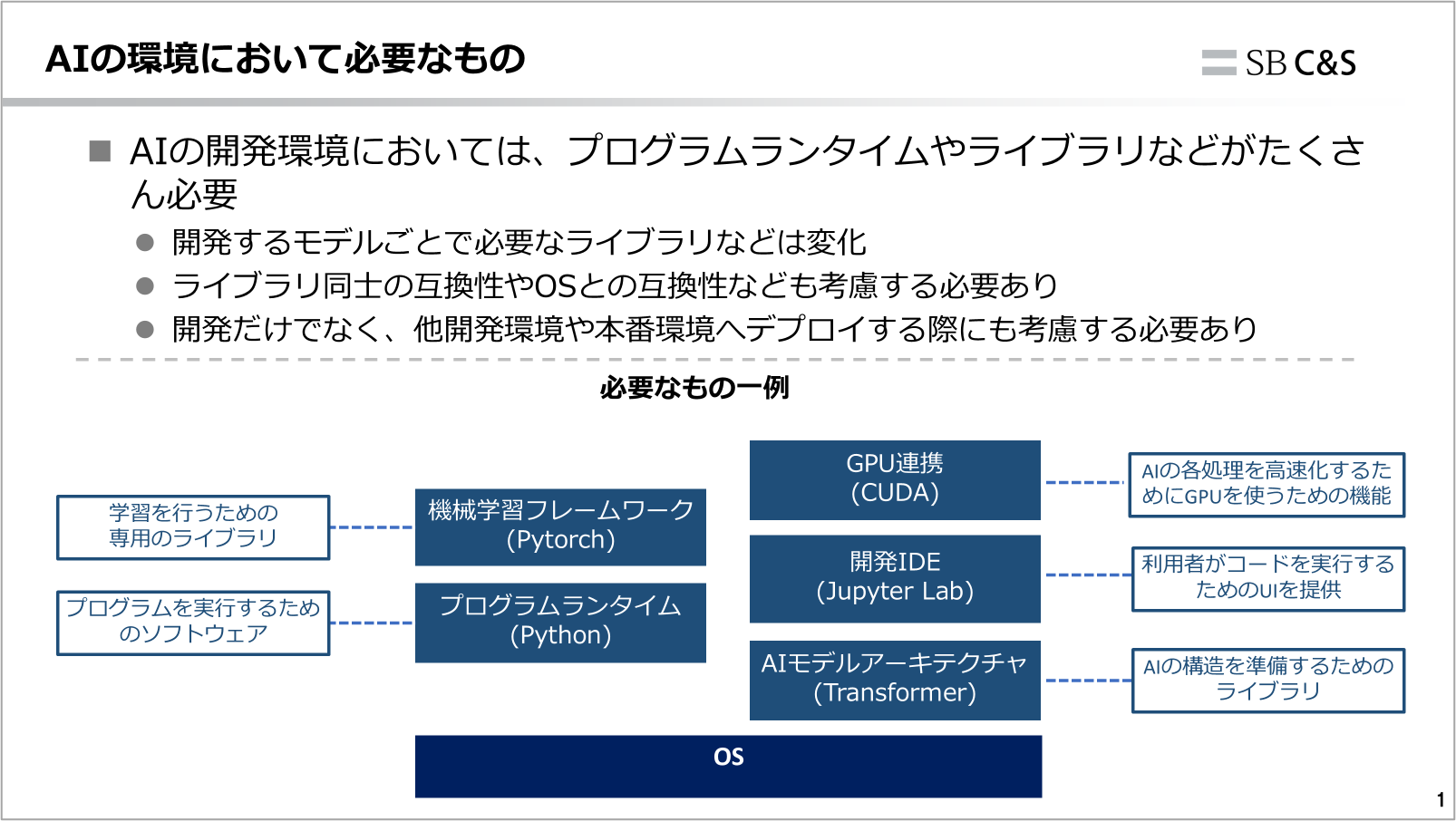

NVIDIA AI Enterpriseは、AIの開発から本番運用で必要となるソフトウェアを「一式提供」「サポート」するソフトウェアスイートです。

開発用環境で必要なライブラリを搭載したコンテナや学習済みのモデルなどのアプリケーションに関連したものから、各種ドライバやKubernetes Operatorなどのインフラストラクチャの領域まで提供されています。

また、提供されるものの中には、簡単に推論サーバーを用意できるものや、AIインフラの統合管理を可能とするソフトウェアなどの、よりAI環境を便利にするものも含まれています。

以降ではNVIDIA AI Enterpriseの代表的なソフトウェアや、利用方法などについて紹介していきます。

アプリケーションソフトウェア

アプリケーションソフトウェアとしては、AIモデルの開発部分から、生成AI活用で便利なソフトウェア群が多く提供されています。

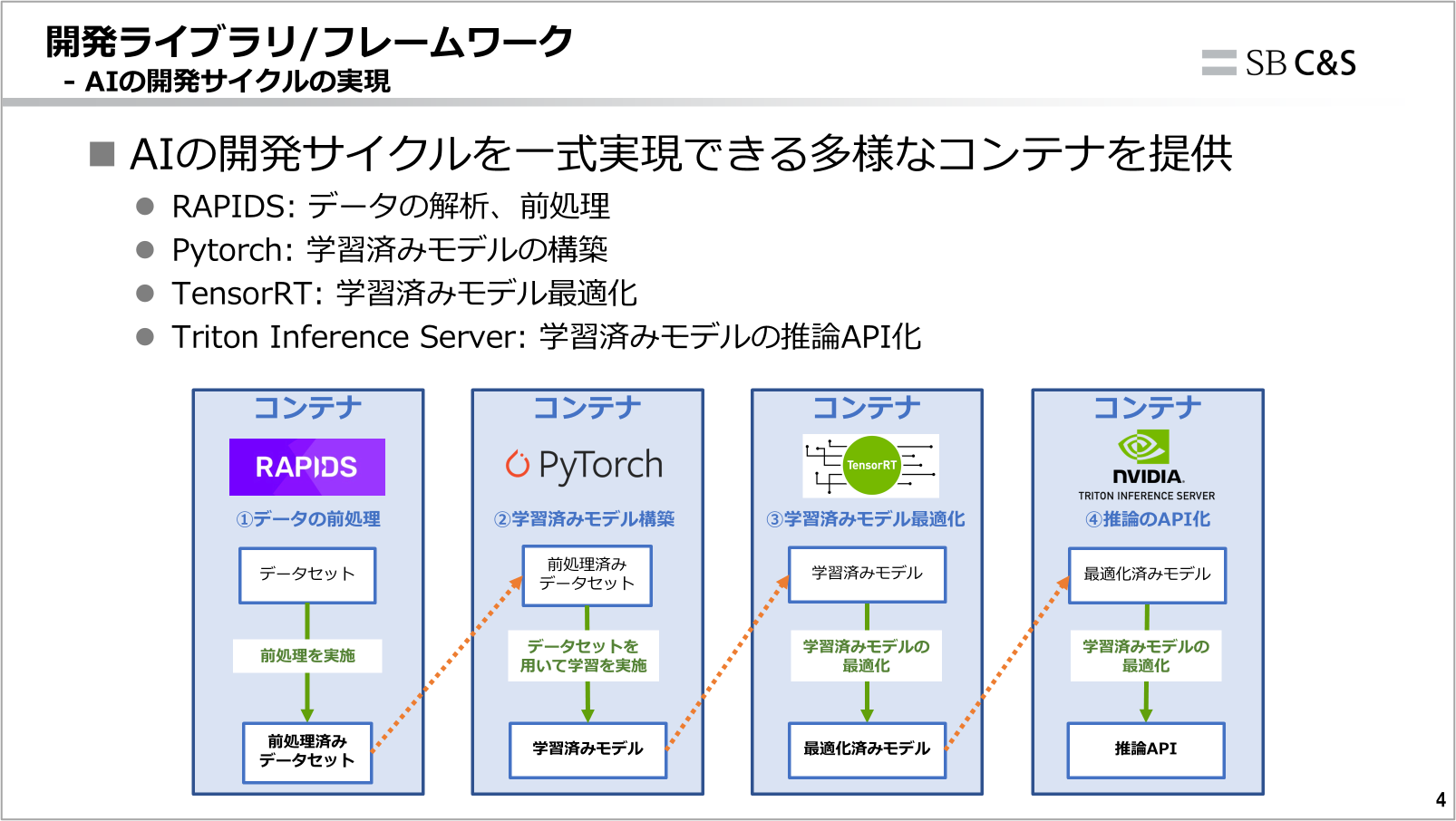

開発ライブラリ/フレームワーク

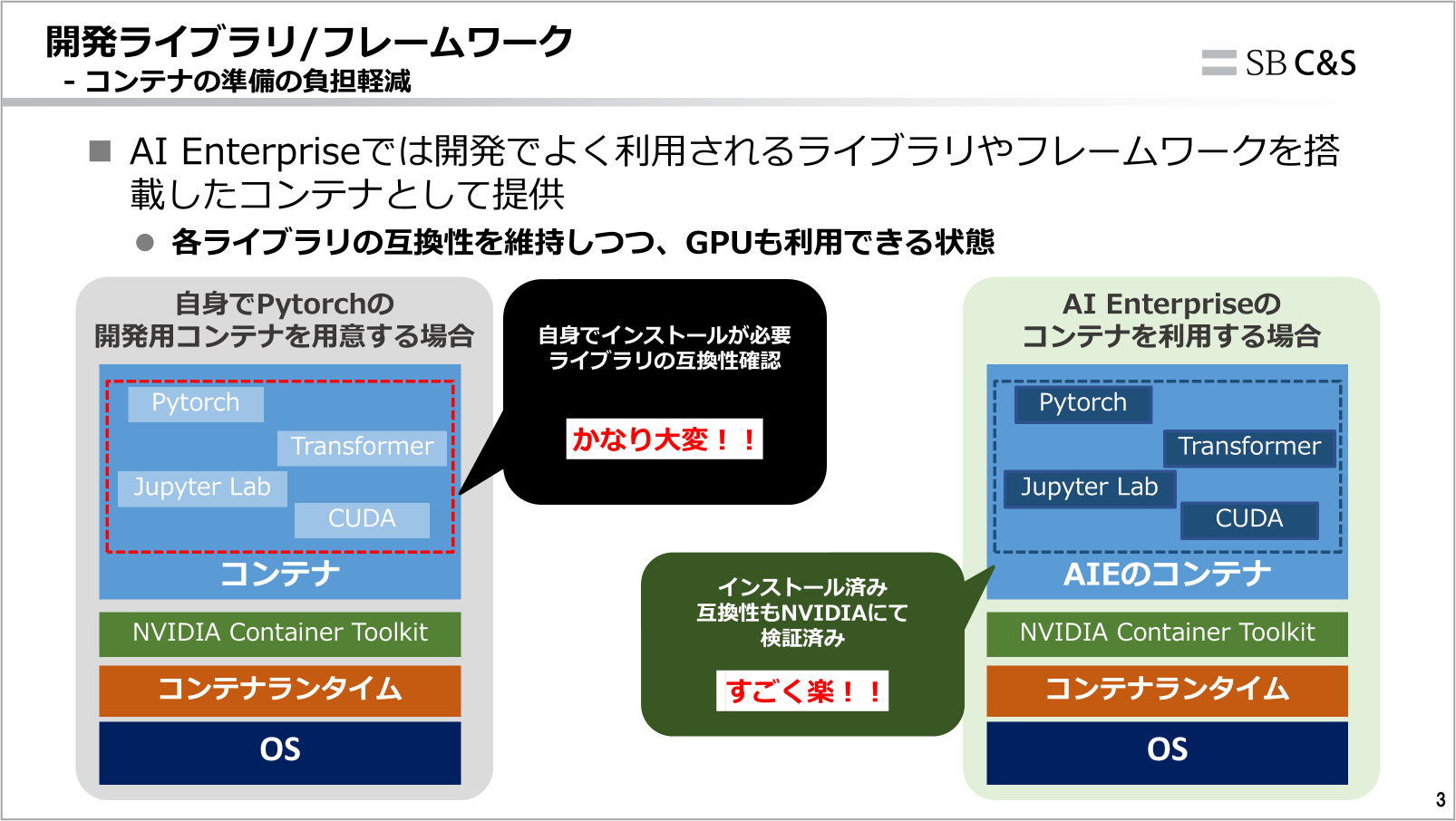

開発でよく利用されるライブラリやフレームワークを搭載したコンテナイメージが、数多く提供されています。

例えばPyTorchのコンテナを例に上げると、自身で用意する場合、必要なプログラムランタイムやライブラリなどをインストールする必要があります。また、それらの互換性確認も必要です。

一方でAI Enterpriseで提供されるコンテナでは、必要なライブラリなどがNVIDIAによって互換性も検証済みの状態で全てインストール済みになっています。これにより、すぐにAIの開発で利用開始できるようになっています。

提供されているコンテナイメージは多種あり、以下は簡易的な構成にはなりますが、データの処理から推論API化まで、一気通貫でAI Enterpriseのコンテナで実現することも可能です。

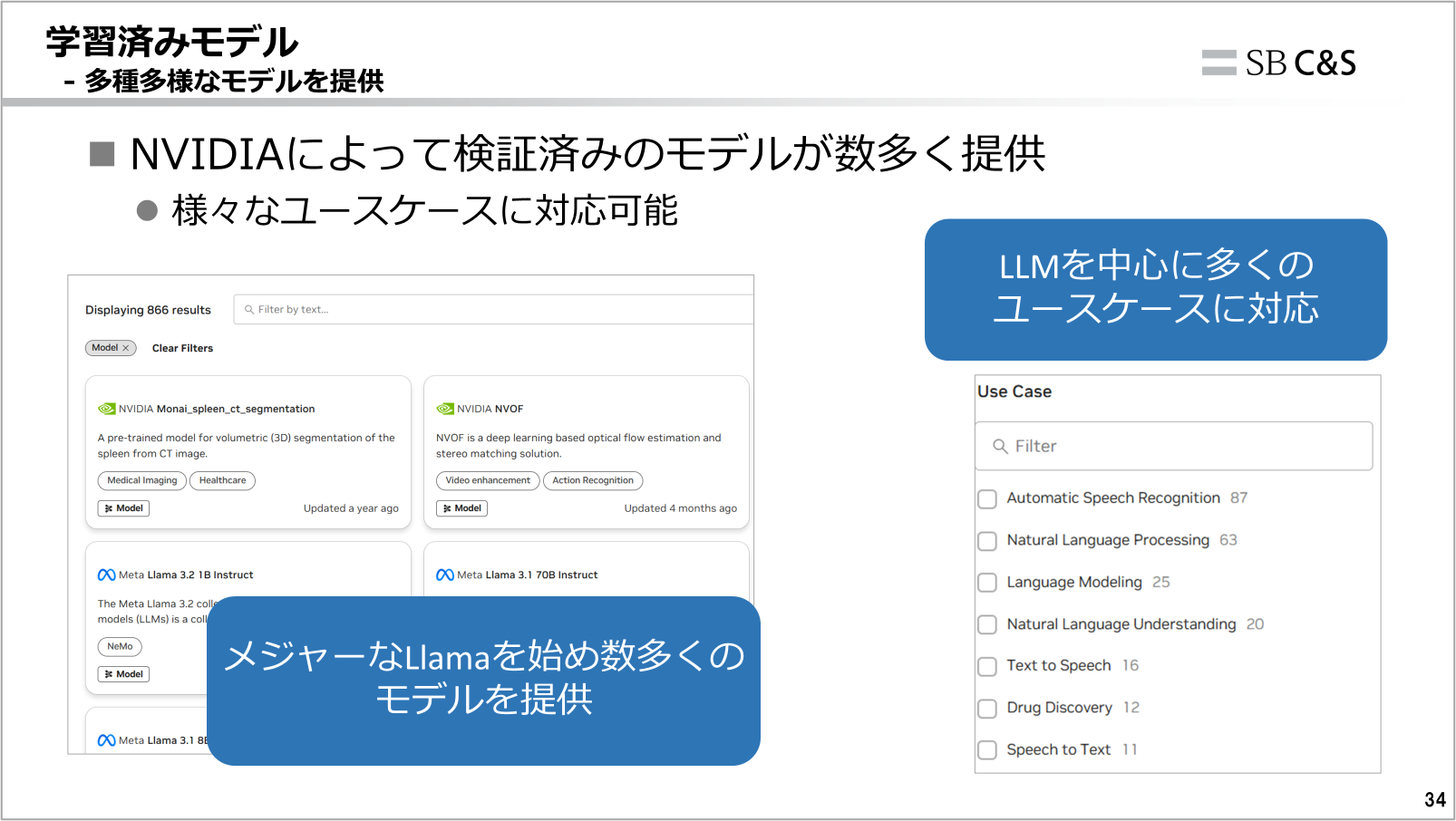

学習済みモデル

NVIDIAによって検証済みの学習済みAIモデルが、数多く提供されています。LLMをはじめ、現在は学習済みモデルをそのまま利用したり、ベースに追加学習したりすることも増えました。それらもAI Enterpriseから入手することが可能です。

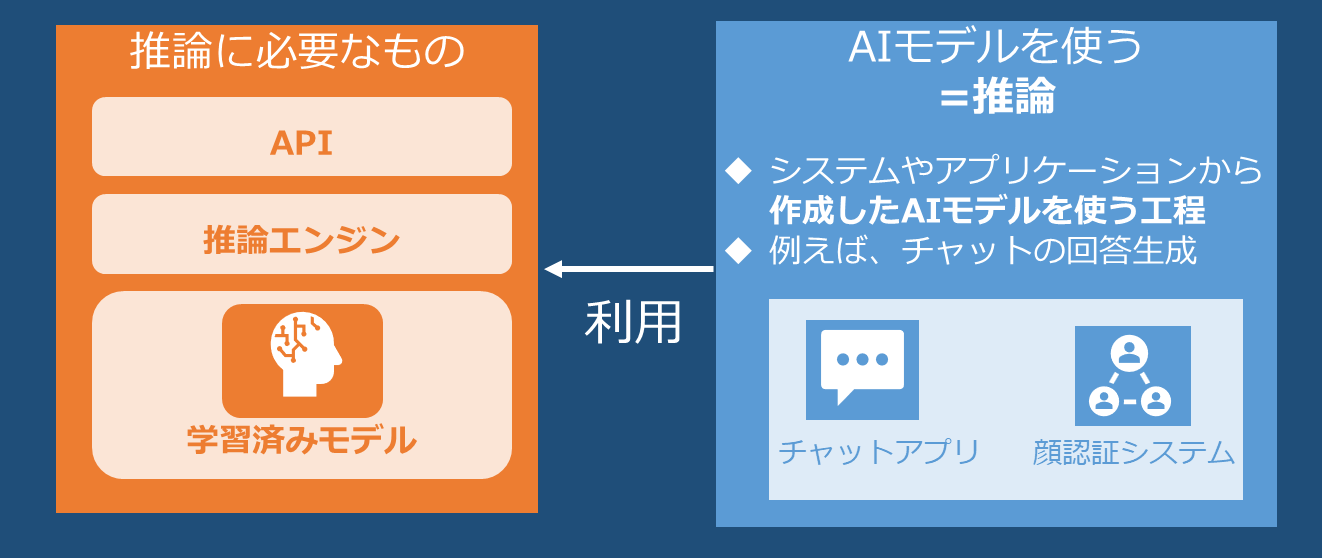

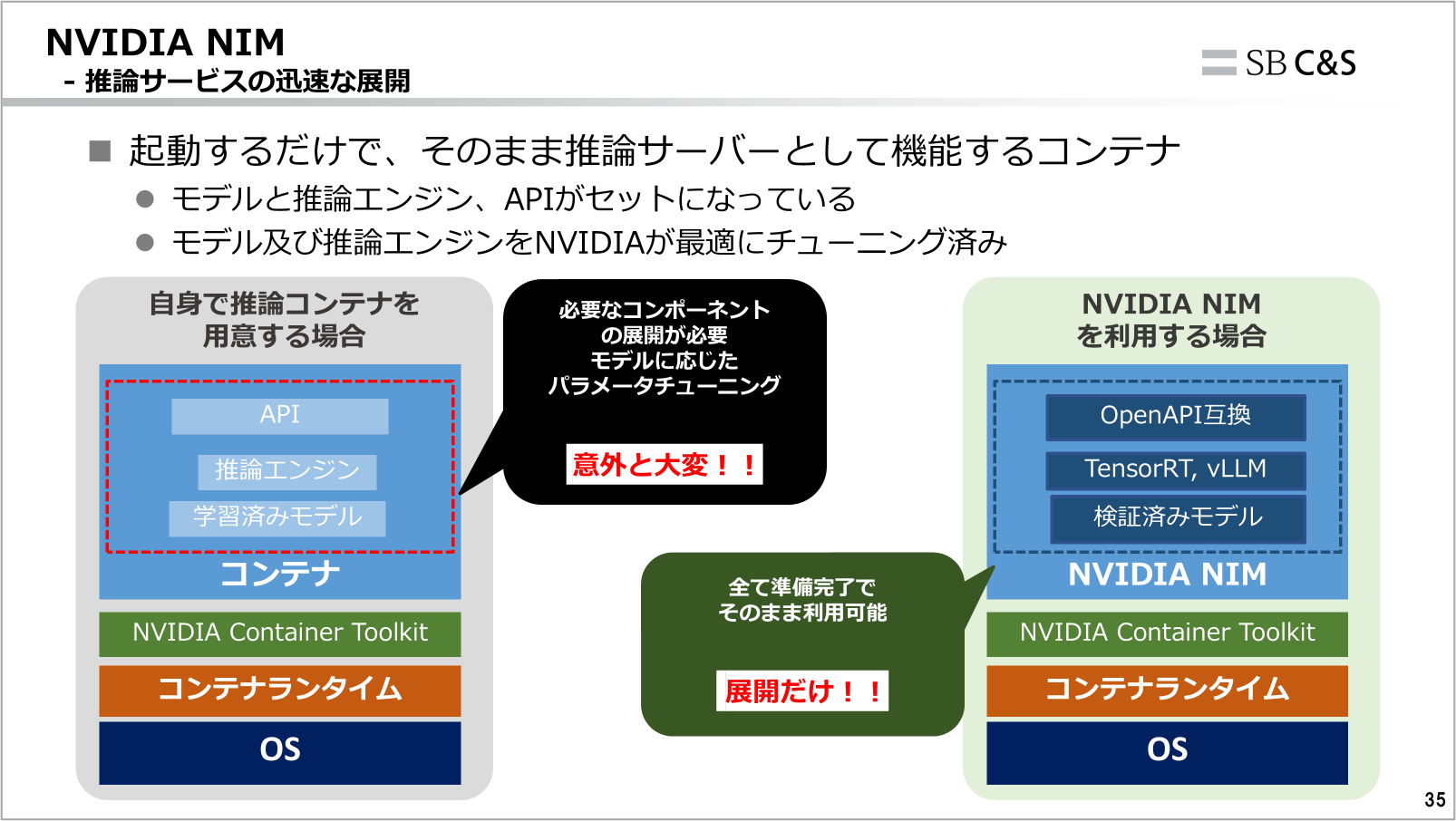

NVIDIA NIM

NVIDIAから提供されているコンテナで、起動するだけでそのまま推論サーバーとして利用できます。

従来は、推論サーバーとして動作させるにはモデルを準備するだけでは足りず、推論エンジンとAPIの仕組みも用意する必要がありました。

NVIDIA NIMでは、推論に必要なものがモデル含めて全て含まれているコンテナが提供されています。これにより、モデルごとに決まったコンテナを起動するだけでそのまま推論に利用できます。

NVIDIA NIMについては以下の記事でも紹介していますので、合わせてご参照ください。

NVIDIA NIMを用いた推論サーバーの展開

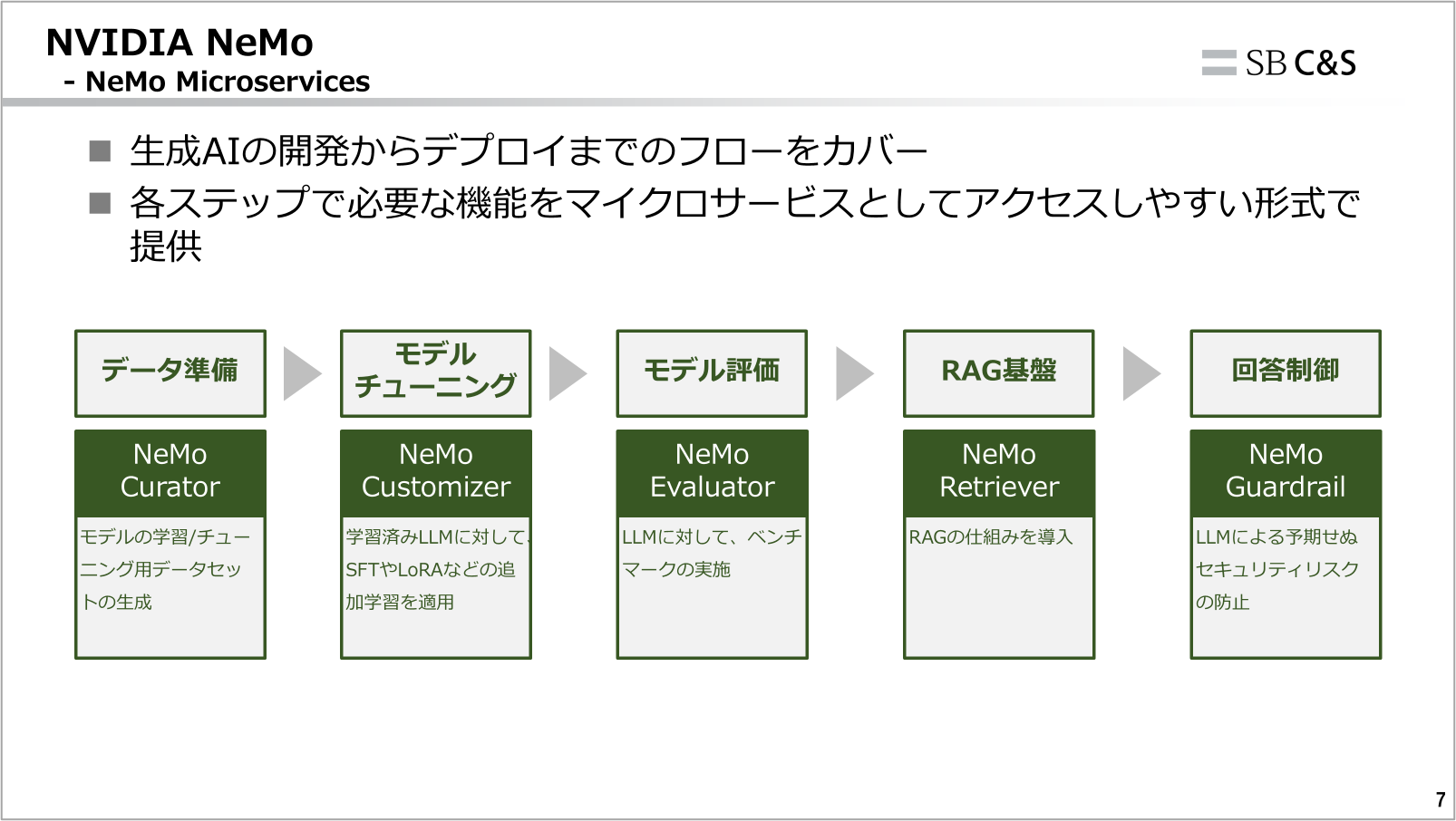

NVIDIA NeMo

生成AIモデル自体の開発や、生成AIモデルを使ったシステム構築で必要な機能を提供するサービス群です。NeMo〇〇といったサービスが数多く提供されており、それぞれで役割が異なります。

例えば、NeMo EvaluatorはLLMのベンチマーク、NeMo GuardrailsはLLMの回答制御などといったものです。

別の記事にていくつかピックアップして紹介していますので、合わせてご参照ください。

NVIDIA NeMo Evaluatorの紹介

NVIDIA NeMo Guardrailsの紹介

インフラストラクチャソフトウェア

インフラストラクチャソフトウェアとしては、GPUを用いたAI基盤作りで必要となるソフトウェアが数多く提供されています。

各種ドライバ

AIインフラではいくつかのドライバが必要となってきます。例えば、GPUを使うためのドライバやネットワーク用途のドライバなどがあります。それらもAI Enterpriseにて提供・サポートがされます。

AI Enterpriseで提供されているドライバおよび関連コンポーネントの代表例は以下です。

- NVIDIA GPU Driver

- GPUを使う場合必須のドライバ

- OSやソフトウェアランタイムからGPUに命令などを行う

- NVIDIA DOCA-OFED Driver

- 分散学習などの低遅延な通信 (RDMA等)で利用されるネットワークドライバ

- NVIDIA Fabric Manager

- NVSwitchを使うマルチGPU構成でのGPU間通信を管理するコンポーネント

- GPUドライバと合わせてインストールする

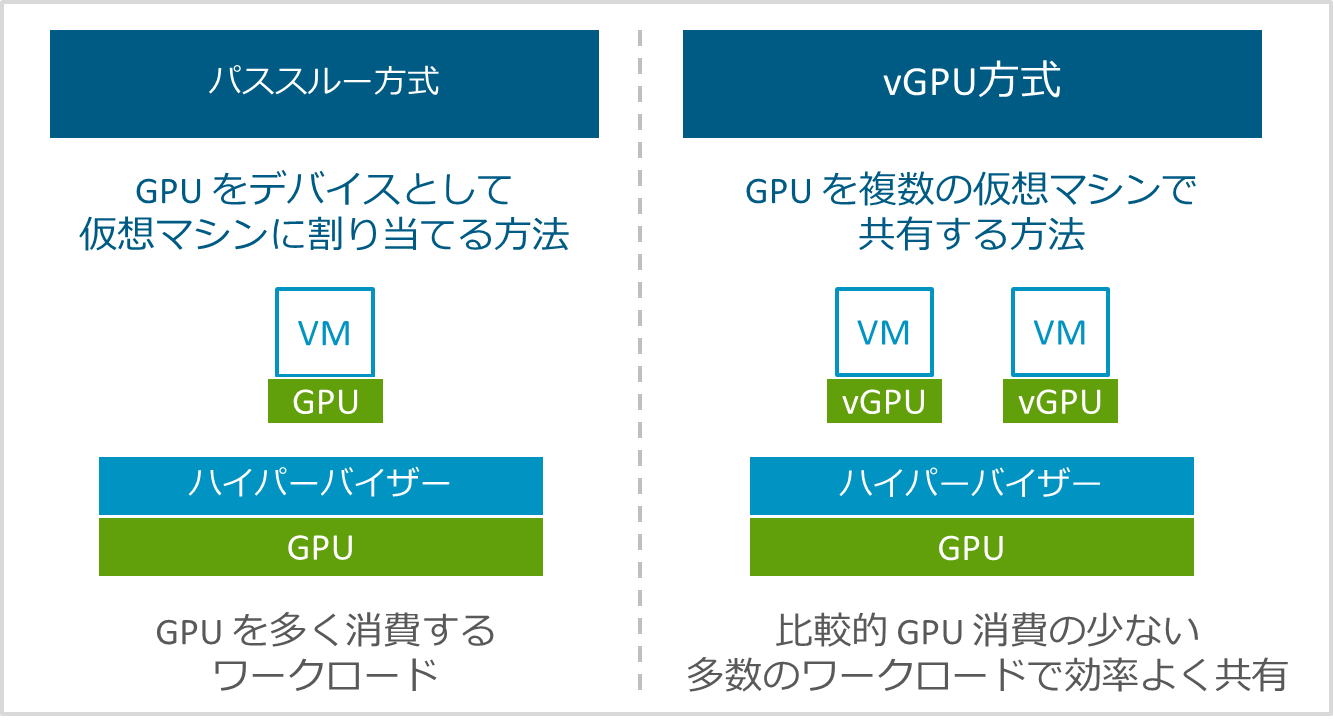

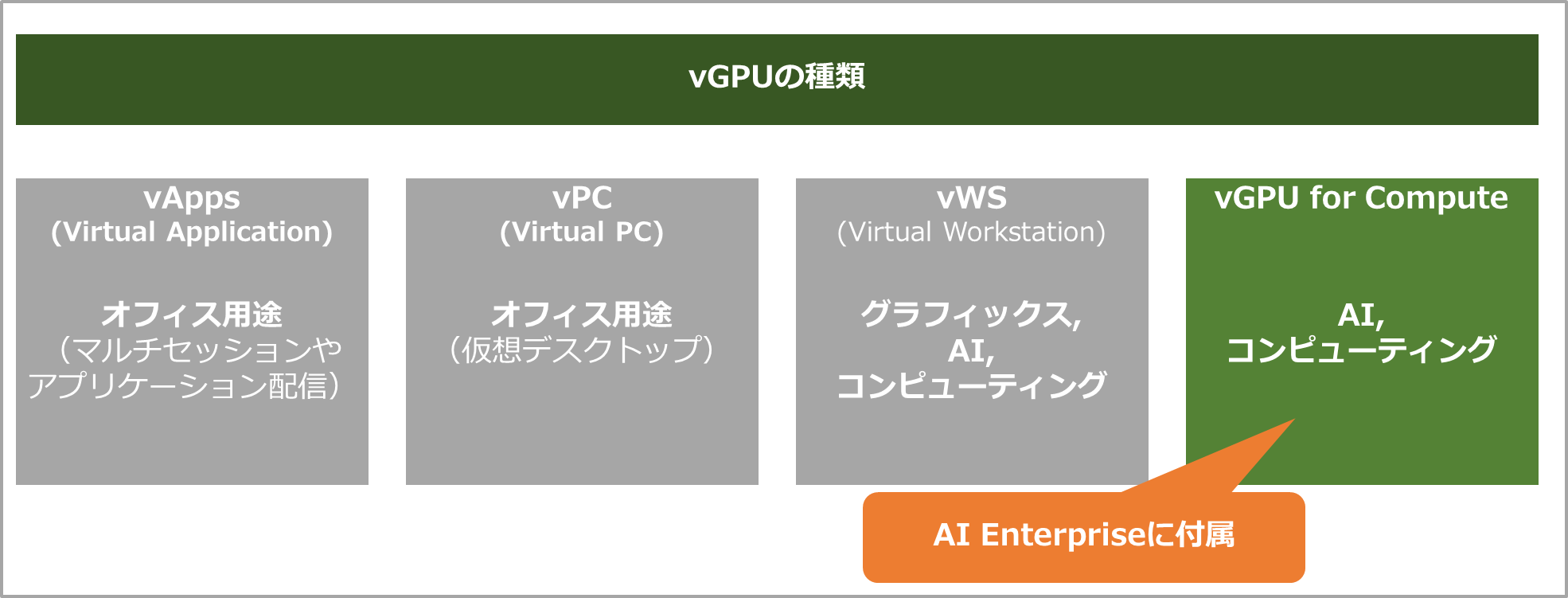

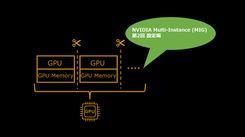

NVIDIA vGPU

AI Enterpriseでは、GPUを仮想化して複数台のマシンに割り当てるvGPUも提供されます。

なお、注意点としてvGPUにはいくつかのライセンスの種類があり、AI Enterpriseで提供されるvGPUはAI用途向けのものとなります。グラフィックスなどの用途で使いたい場合は、別でvGPUの該当ライセンスが必要です。

NVIDIA vGPUについては以下記事でも紹介していますので、合わせてご参照ください。

NVIDIA vGPU ご紹介

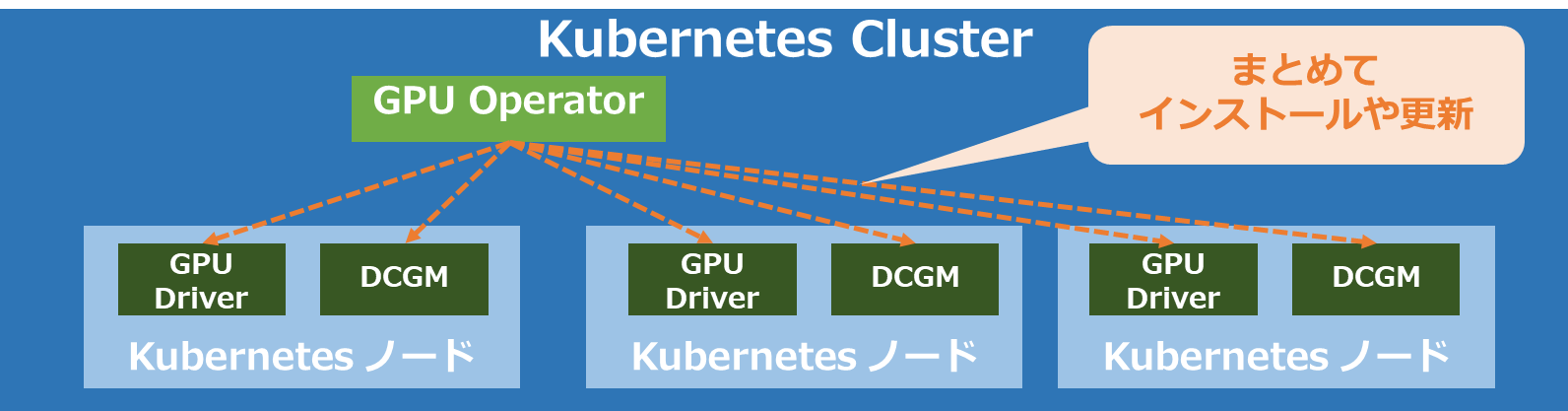

Kubernetes Operator

AIのインフラストラクチャではKubernetesが採用されるケースも多くなっています。そのKubernetesでのAI環境の管理で必要となるKubernetes Operatorも、AI Enterpriseにて提供されています。

例えばGPU Operatorでは、Kubernetesの各ノードへのGPU Driverや監視用ツールのインストールなどをまとめて管理することができます。

AI Enterpriseにて提供されているKubernetes Operatorの代表例は以下となります。

- NVIDIA GPU Operator

- 各ノードへのGPUドライバやDCGMなどの監視ツールのインストールをまとめて管理

- NVIDIA Network Operator

- 各ノードへのネットワークドライバインストールなどをまとめて管理

- NVIDIA NIM Operator

- Kubernetes環境でNIMを運用するための機能群(デプロイ、スケーリングなど)を提供

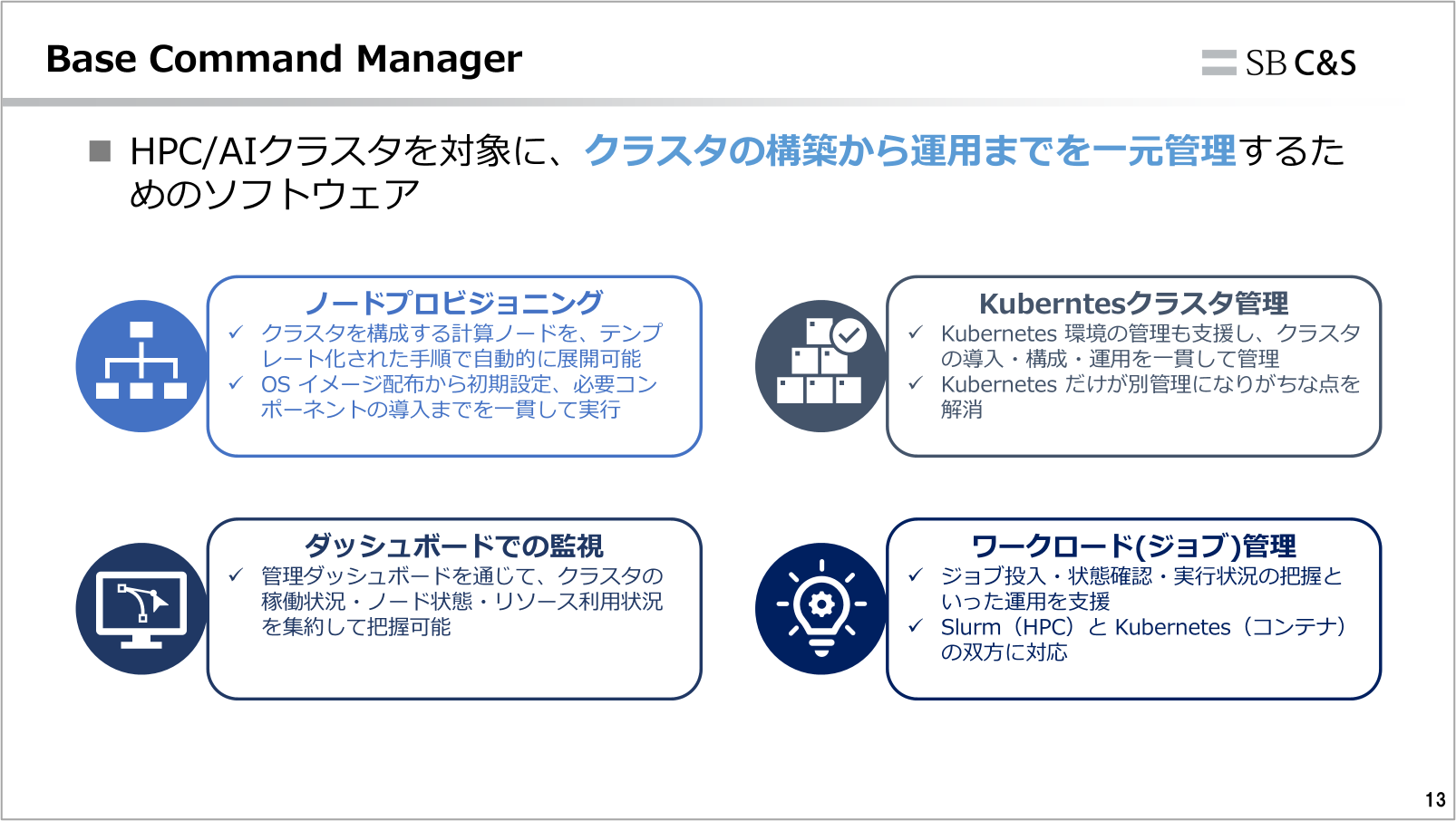

Base Command Manager

AI インフラの統合管理を支援するコンポーネントとして Base Command Managerが提供されています。

Base Command Managerは、HPC/AIクラスタを対象に、クラスタの構築から運用までを一元管理するためのソフトウェアです。ノードプロビジョニング、Kubernetesクラスタ管理、ノード監視、ワークロード管理の機能を提供し、AI 基盤運用で発生しがちな管理負荷や構築時間を大幅に削減します。

Base Command Managerについては以下記事でも紹介していますので、合わせてご参照ください。

AIインフラの司令塔!NVIDIA Base Command Managerのご紹介

ソフトウェアライフサイクル

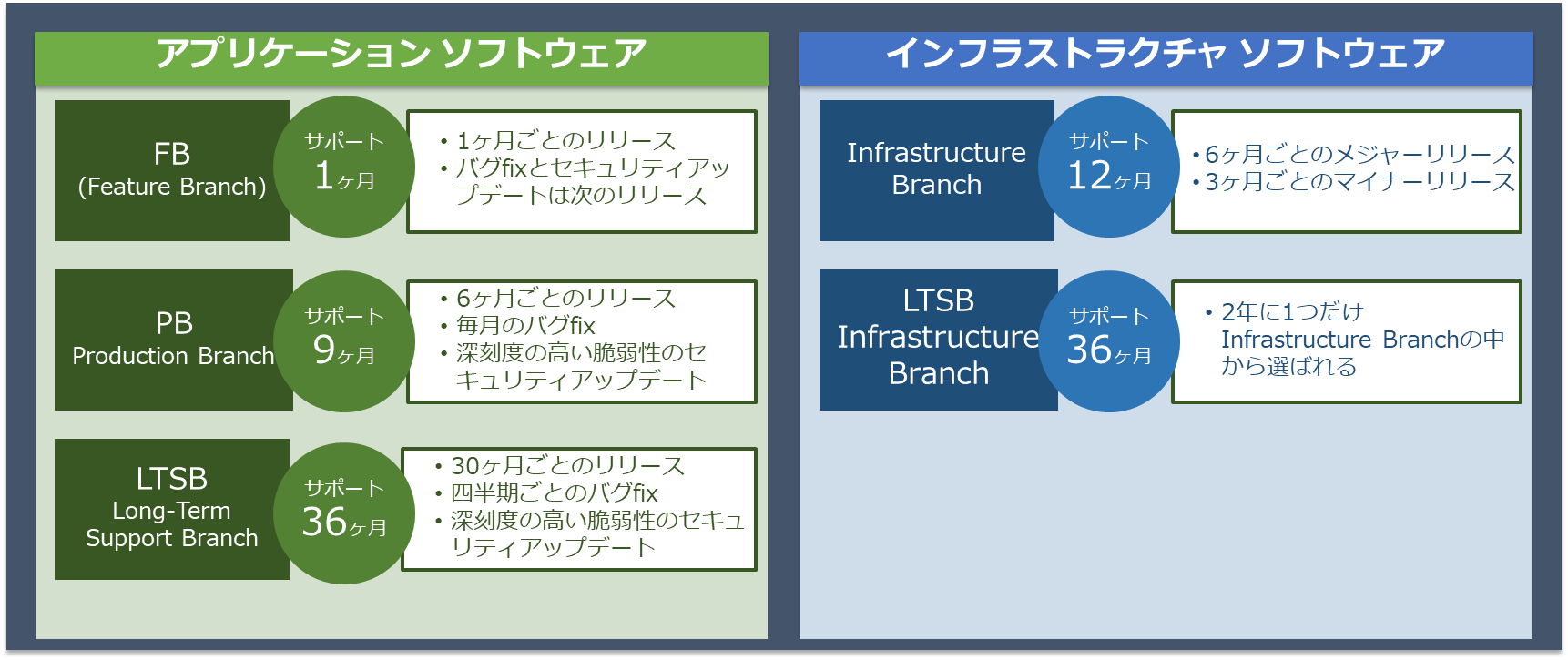

NVIDIA AI Enterpriseでは複数のライフサイクルでソフトウェアが提供されます。

アプリケーションソフトウェアでは以下の3つがあります。

- Feature Branch(FB)

- 原則、月次リリース

- サポート期間は 1 か月

- 最新版を検証したい場合や、迅速に追従する必要がある場合に利用

- Production Branch(PB)

- 6 か月ごとのリリース

- サポート期間は 9 か月

- 安定運用向け

- Long-Term Support Branch(LTSB)

- 30 か月(約 2.5 年)ごとのリリース

- サポート期間は 3 年

- 長期運用向け

インフラストラクチャソフトウェアは原則 Infrastructure Branchで提供されます。加えて、Infrastructure Branch から2 年に一度 LTSB 版がリリースされるため、ここでは分けて記載します。

- Infrastructure Branch

- 6 か月ごとのメジャーリリース、3 か月ごとのマイナーリリース

- サポート期間は1年

- LTSB Infrastructure Branch

- 2 年に一度、Infrastructure Branch から LTSB としてリリース

- サポート期間は 3 年

- サポート期間以外の基本方針は Infrastructure Branch と同じ

AI Enterprise ソフトウェアの利用方法

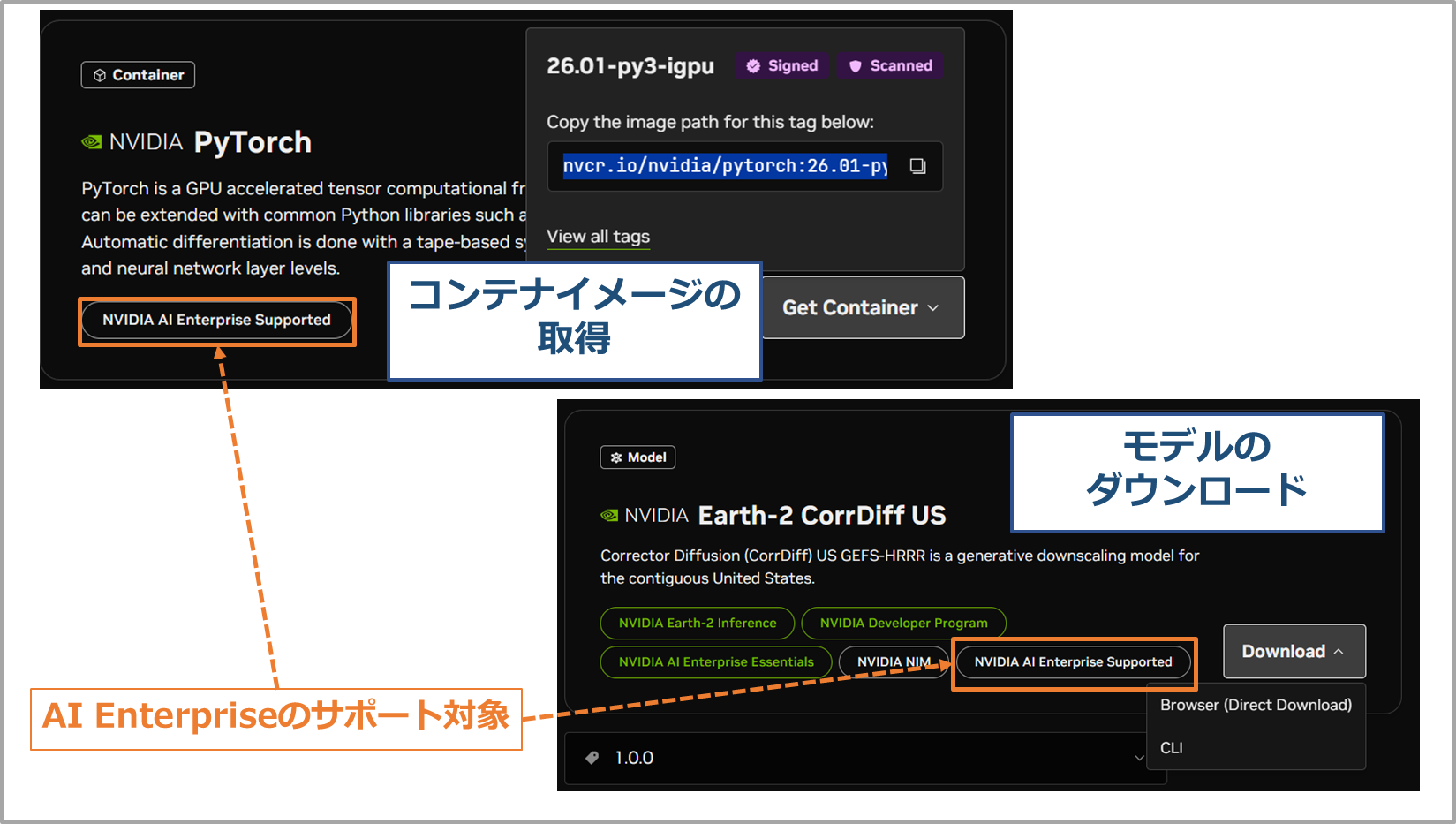

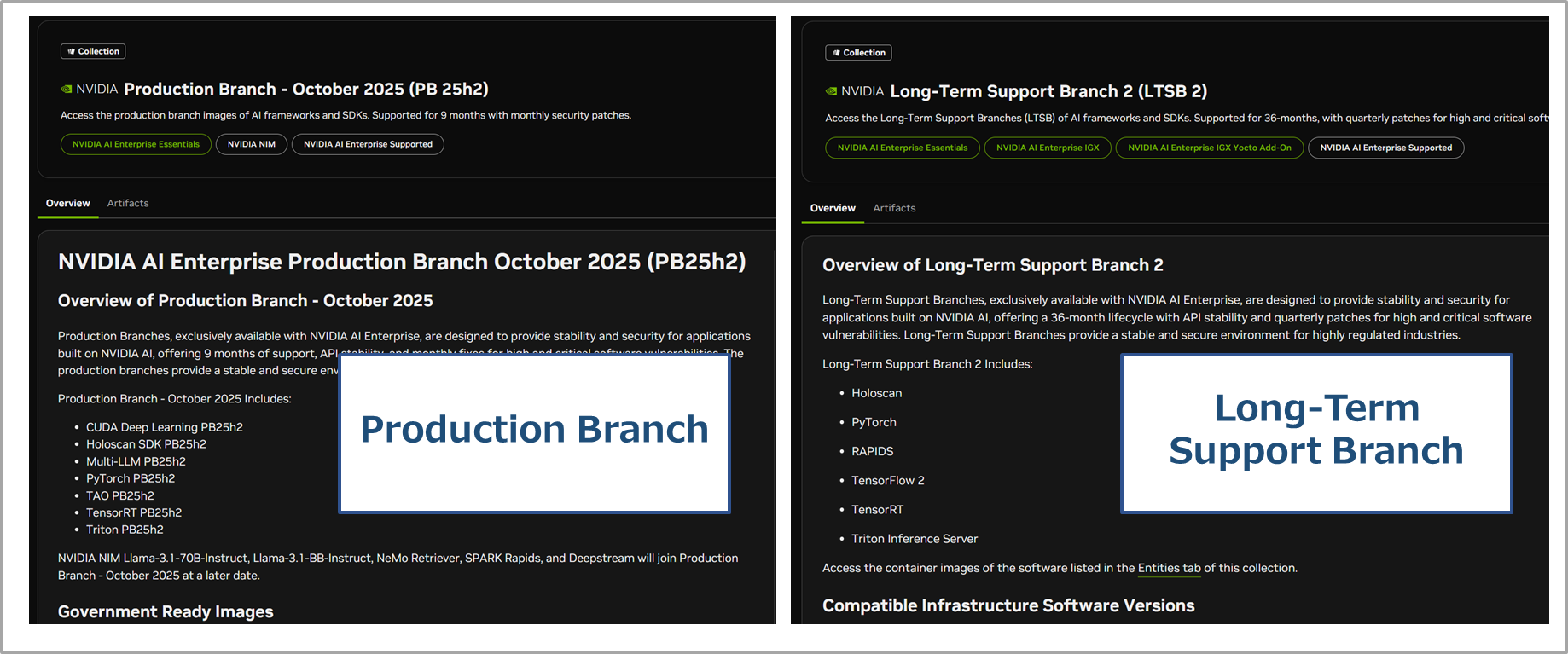

AI Enterpriseのコンポーネントの多くはNVIDIA NGC Catalogから入手して利用することができます。例えばコンテナ形式のものであればコンテナイメージのパス、モデルであればダウンロードボタンが用意されています。

NGC Catalogでは、ラベルで「NVIDIA AI Enterprise Supported」と記載があるものがAI Enterpriseのサポート対象となります。このラベルが付くコンテンツは、NVIDIA により互換性検証・サポート提供の範囲が明確化されています。これは、NGC CatalogにはAI Enterpriseのサポート外のものも掲載されているためです。

https://catalog.ngc.nvidia.com/

また、ライフサイクルのところでも紹介した各BranchもNGC Catalog上から確認できます。

なお一部コンポーネントは、NGC以外から取得が必要です。例えば、vGPU用のドライバは「NVIDIA Licensing Portal」、Base Command ManagerのISOは「Bright Computing Customer Portal」から入手します。この点はソフトウェアによって異なるため、それぞれのドキュメントをご参照ください。

まとめ

NVIDIA AI Enterpriseの全体像を紹介しました。AIでは開発から本番運用までを含めると非常に多くのソフトウェアが必要となります。それらを一括で提供及びサポートをしてくれるNVIDIA AI Enterpriseは企業でのAI導入の一助になると考えます。

他のおすすめ記事はこちら

著者紹介

SB C&S株式会社

ICT事業本部 技術本部 第1技術統括部

第2技術部 1課

村上 正弥 - Seiya.Murakami -

VMware vExpert